NVIDIA Omniverseを活用したロボットの動作試験のためのROS連携シミュレーション環境

国立大学法人 筑波大学

筑波大学が実施する人協調型ロボット開発※1の研究プロジェクトで用いるシミュレーション環境として、NVIDIA Omniverse(オムニバース、以下「Omniverse」)※2を活用した3Dデジタルツイン※3による実寸大の仮想空間を開発・提供しました。(2025年3月)

人協調型ロボット開発のためのシミュレーション環境

当社が開発した仮想空間は、現実空間に存在するロボットや居室などに取り付けられた各種センサーデータのほか、ロボットの動作のモーションキャプチャーデータなどをシミュレーター上の3Dモデルに反映させることにより、事前のシミュレーションを可能にするものです。

筑波大学の研究プロジェクトにおいて、開発した人協調型ロボットの動作試験を行うために利用されています。

当社は、クラウド上のデータにアクセスしてOmniverseに取り込むため、独自のExtension(機能を拡張するためのプラグイン)もPythonスクリプトで開発、実装しました。また、仮想空間で発生したロボットとほかのオブジェクトとの衝突結果をROS※4連携でOmniverse外に通知する仕組みも構築しています。

筑波大学が実施した研究の詳細については下記をご参照ください。

原著論文:Development of human collaborative robot to perform daily tasks based on multimodal vital information with cybernics space., A. Uehara, H. Kawamoto, and Y. Sankai, Frontiers in Robotics and AI, (Sec. Biomedical Robotics, Volume 12 – 2025, DOI 10.3389/frobt.2025.1462243)

筑波大学プレスリリース:「サイバニクス空間で日常生活を支援する人協調型ロボットを開発」(2025.03.19)

URL https://www.tsukuba.ac.jp/journal/technology-materials/20250319140000.html

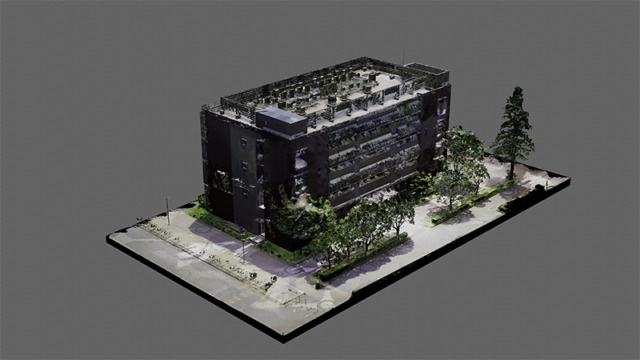

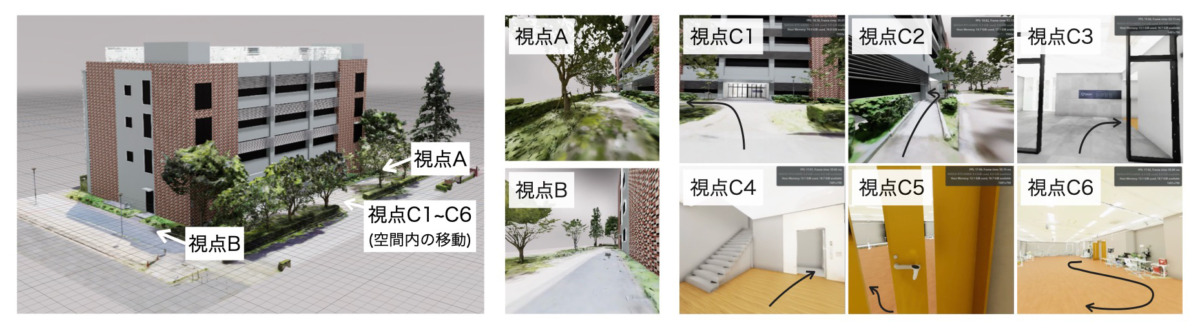

仮想空間には、筑波大学の研究棟建屋のほか、歩道や障害者駐車スペースと車道を含む周辺、センター内部のエントランスやエレベーター、いくつかの居室、廊下などが含まれます。

3Dモデルは、高精度なレーザースキャナーによる点群データ※5と一眼レフカメラによるフォトグラメトリ※6をベースに制作しました。当社テクニカルアーティスト(TA)が、現場の写真を参照しながら形状が正しくない箇所の修正、樹木に隠れた外壁などの測定されていない箇所の補足、ガラスの透過率の調整などの作業を施しています。

照明やエアコン、家具、家電製品など、一部の3Dモデルは既成のデータを活用して組み合わせ、仕上げました。また、制作した3DモデルはOmniverse上に配置し、HMD(ヘッドマウントディスプレイ)に表示することで、ドアの開閉やエレベーターのボタン操作をすることもできるようにしています。

建物モデル(サイバニクス研究センター)制作過程

なお、このたびの仮想空間の開発・提供について、筑波大学の上原助教より以下のコメントをいただいております。。

本内容はサイバニクス空間のプラットフォームの基盤の一部として発展しうる可能性を秘めているものと考えています。今後は研究成果の社会実装に向けて研究開発をさらに推進していきます。

筑波大学 システム情報系 助教 上原 皓

建物モデル(サイバニクス研究センター)制作過程

※1 人協調型ロボット:人とサイバー・フィジカル空間を融合する「HCPS(Human -Cyber-Physical-Space、融合人協調ロボティクス)」の取り組みを基盤とした、人とテクノロジーが共生・協調して相互に支え合う社会の実現に資するロボット

※2 NVIDIA Omniverse:NVIDIA社が提供する3D設計コラボレーションおよびデジタルツインシミュレーションの開発プラットフォーム

※3 3Dデジタルツイン:現実空間に実在している物体や環境に関する情報を収集し、仮想空間に3Dモデルで再現する技術

※4 ROS:ロボットアプリケーションを開発するためのオープンソースのフレームワークとツールセット

※5 点群データ:3Dレーザースキャナーなどで計測することにより得られる、無数の点の集合体として取得された座標情報(XYZ)と色情報(RGB)を持つ物体表面の形状情報

※6 フォトグラメトリ:対象物をさまざまな角度から撮影した複数の写真から3Dモデルを作成する技術